Chapter 8: 폐루프 에이전틱 시스템

요약

이전 챕터들이 에이전틱 루프의 개별 구성요소 — 계획, 제어, 메모리 — 를 다뤘다면, 이 챕터는 이들을 하나의 폐루프(closed-loop) 시스템으로 통합하는 연구를 다룹니다. REFLECT가 "왜 실패했는지" 설명하는 법을 제시하고, AutoRT가 대규모 로봇 함대를 안전하게 관리하며, BUMBLE이 건물 규모에서 통합 에이전틱 루프를 시연하고, PragmaBot이 경험으로부터 배우는 완전한 에이전틱 로봇을 구현합니다. 이 흐름은 Agentic Coding의 code-execute-debug 루프가 물리 세계에서 어떤 모습을 띠는지를 보여줍니다.

8.1 도입: 에이전틱 루프의 물리적 구현

Agentic Coding의 루프는 이미 완성되어 있습니다. Claude Code가 코드를 생성하고, 실행하고, 에러를 분석하고, 수정하는 전체 과정이 자동입니다. 이 루프가 production-ready인 이유는 Chapter 1에서 분석한 디지털 세계의 세 속성 — 결정론적 실행, 명확한 피드백, 완전한 가역성 — 덕분입니다.

물리 세계에서 같은 루프를 구현하려면 각 단계가 본질적으로 더 어려워집니다. 관찰은 센서 노이즈에 의해 불완전하고, 실행은 확률적이며, 실패 원인은 모호하고, 되돌리기는 불가능합니다. 이 챕터의 네 논문은 이 어려움 속에서 에이전틱 루프를 단계적으로 구현해 나가는 과정입니다.

8.2 REFLECT: 실패를 설명하다

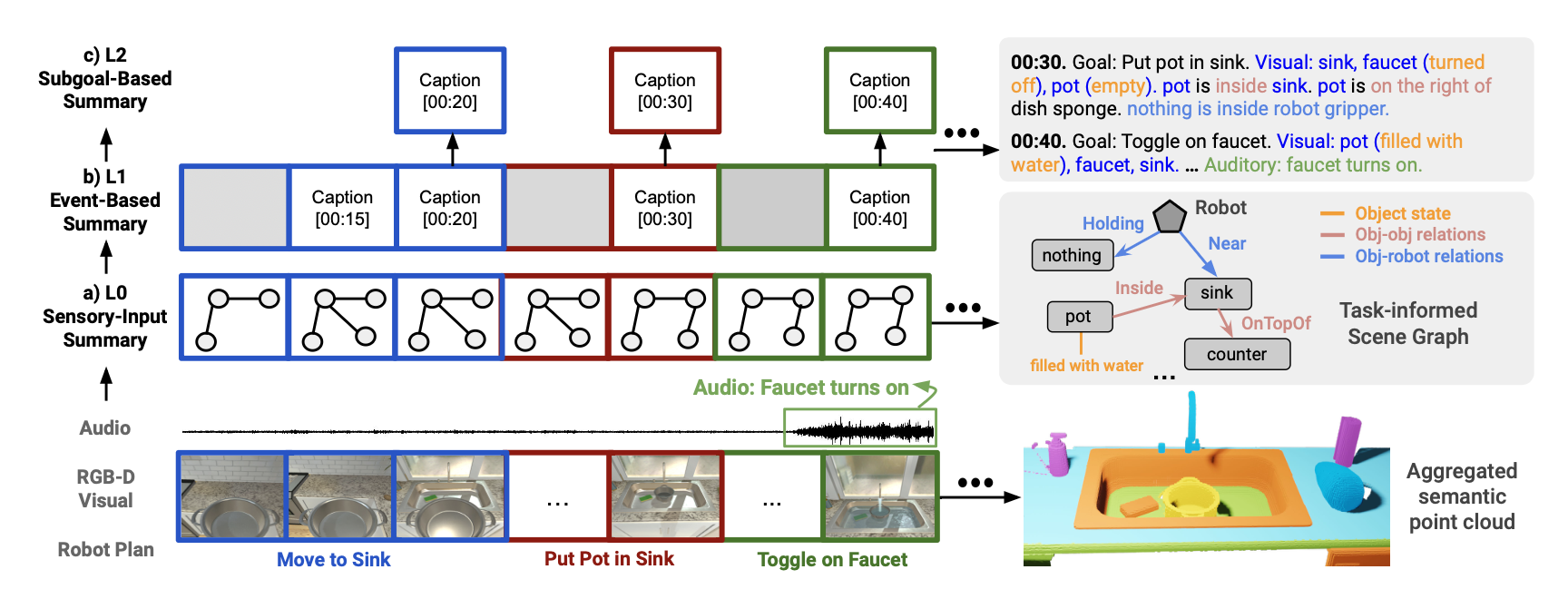

[Liu et al., 2023]의 REFLECT는 에이전틱 루프의 핵심 구성요소 — 반성(reflection) — 을 로봇에 도입합니다. 다중 감각(multisensory) 관찰을 기반으로 로봇의 과거 경험을 계층적으로 요약하고, LLM에 쿼리하여 실패 원인을 설명합니다.

방법론은 네 단계입니다. 다중 감각 데이터에서 계층적 경험 요약을 생성합니다(시간적·의미적 추상화). Progressive Failure Explanation으로 LLM이 요약을 점진적으로 분석하여 실패 원인을 추론합니다. 실패 설명을 기반으로 언어 기반 플래너가 교정 계획을 생성합니다. RoboFail Dataset으로 다양한 실패 시나리오를 평가합니다.

REFLECT는 Agentic Coding의 에러 분석 → 디버깅 → 수정 루프와 직접 대응됩니다. 핵심 차이: 코드 에러는 스택 트레이스와 로그로 원인이 비교적 명확하지만, 로봇 실패는 시각·힘·위치 등 다중 감각 데이터에서 원인을 추론해야 합니다. "왜 실패했는지" 판단 자체가 로봇에서 훨씬 어렵습니다.

8.3 AutoRT: 대규모 안전한 자율성

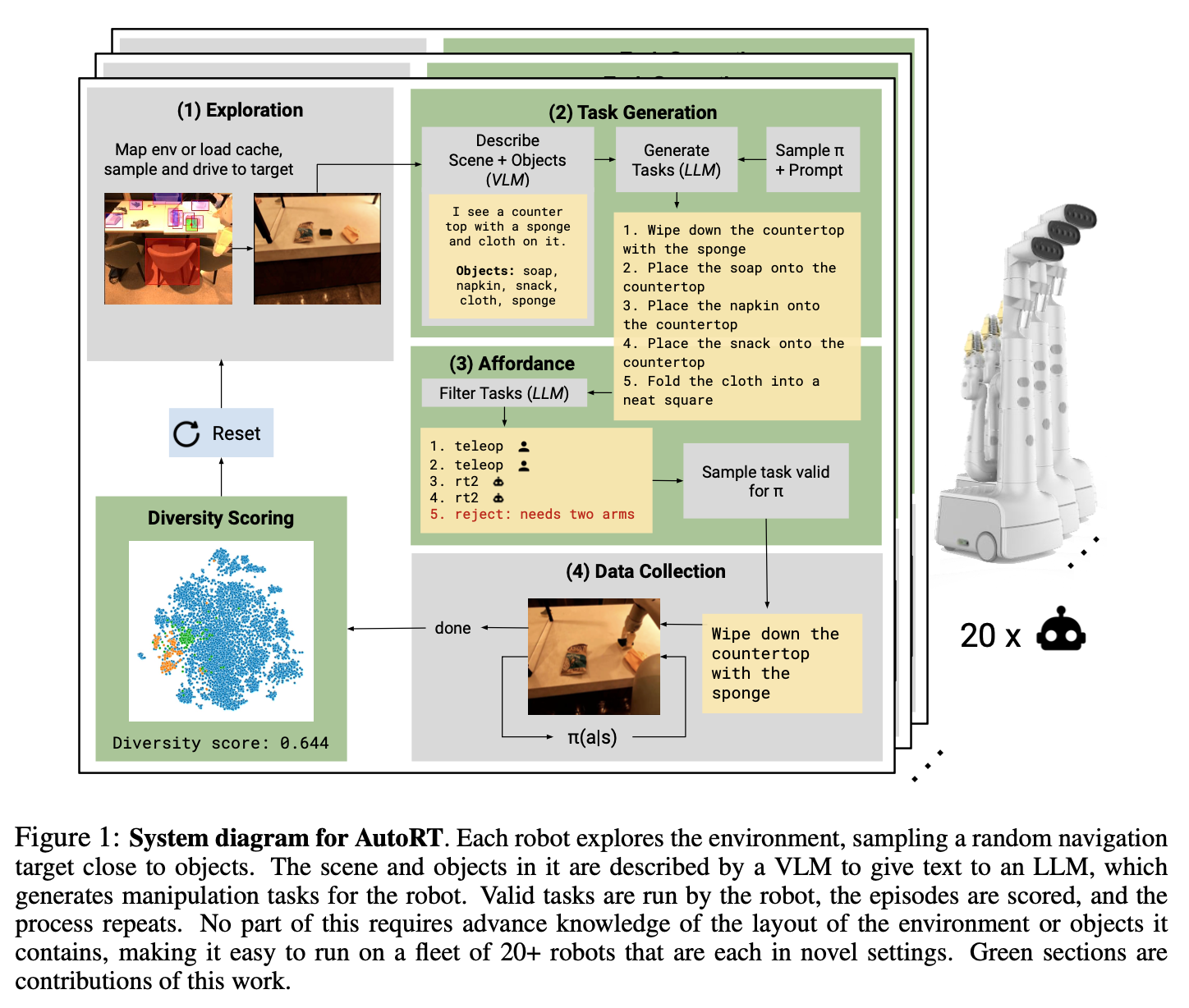

[Brohan et al., 2024]의 AutoRT는 에이전틱 로보틱스의 규모를 한 차원 끌어올립니다. VLM(씬 이해) + LLM(작업 제안) + Robot Constitution(로봇 헌법)으로 다수의 로봇을 자율 관리하는 시스템입니다.

7개월간 4개 건물에서 20대 이상의 로봇을 운영하며 77,000개의 시연 데이터를 수집했습니다. 단일 인간이 5대의 로봇을 감독하는 1:5 비율로 운영되었습니다.

Robot Constitution은 Asimov의 로봇 3원칙에서 영감받은 안전 가이드라인입니다. 기본 안전 규칙 + embodiment 제약 + 작업별 제한을 계층적으로 적용합니다. "물체를 인간에게 던지지 말 것", "식품을 전자레인지에 넣을 때 포장을 제거할 것" 같은 규칙을 LLM이 자동 생성합니다.

이것은 Agentic Coding의 시스템 프롬프트와 안전 가드레일에 대응됩니다. Claude Code가 "파괴적 작업 전 확인", "보안 취약점 방지" 규칙을 따르듯, AutoRT의 로봇은 Robot Constitution을 따릅니다. 핵심 차이: 코드에서 안전 위반은 git revert로 되돌릴 수 있지만, 로봇의 물리적 사고는 되돌릴 수 없습니다. 이 비가역성이 Robot Constitution의 존재 이유입니다.

8.4 BUMBLE: 건물 규모의 통합 에이전트

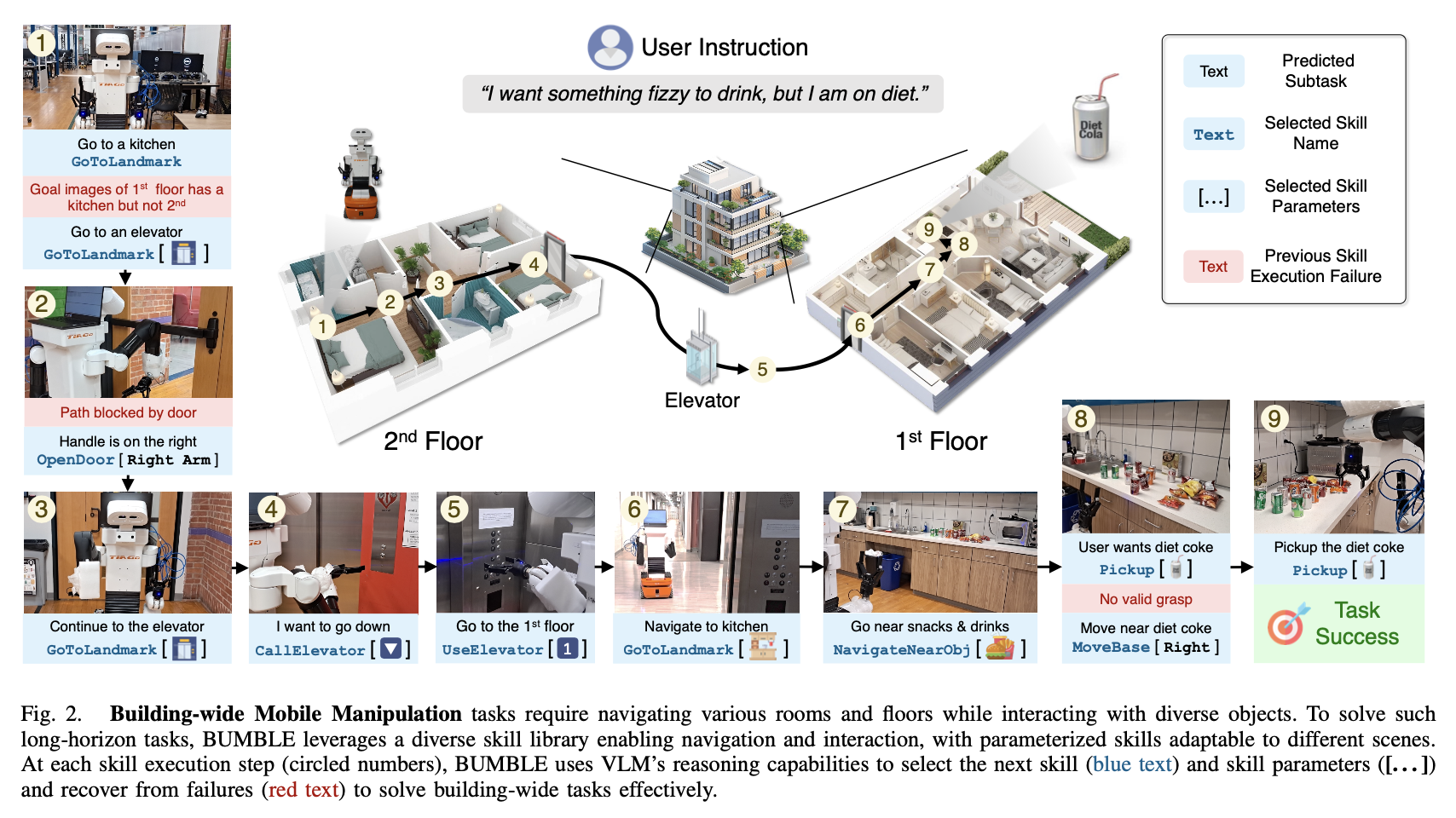

[Shah et al., 2024]의 BUMBLE은 VLM 기반으로 추론과 행동을 통합하여 건물 규모(building-wide)의 모바일 조작을 수행하는 가장 포괄적인 에이전틱 프레임워크입니다.

VLM이 RGBD 인식, 조작 스킬 라이브러리, 이중층 메모리를 통합 관리합니다. 자유 형식 언어 지시를 받아 파라미터화된 스킬을 선택·실행하며, 실패를 감지하면 재계획합니다.

90시간 이상의 평가에서 70회 시행, 평균 성공률 47.1%, 최대 12단계 스킬 시퀀스, 시행당 약 15분이 소요되었습니다. 주요 실패 원인은 VLM 추론 오류 — 충돌 예측 실패, 20-25개 distractors에서 오객체 선택, 엘리베이터 버튼 오인식 — 였습니다.

47.1%라는 성공률은 솔직한 현주소를 보여줍니다. Agentic Coding이 production-ready 수준의 완성도를 달성한 반면, Agentic Robotics는 연구 프로토타입 단계에 있습니다. 이 격차의 핵심은 VLM 추론 능력 자체가 시스템의 상한선이라는 점입니다.

8.5 PragmaBot: 경험으로부터 배우다

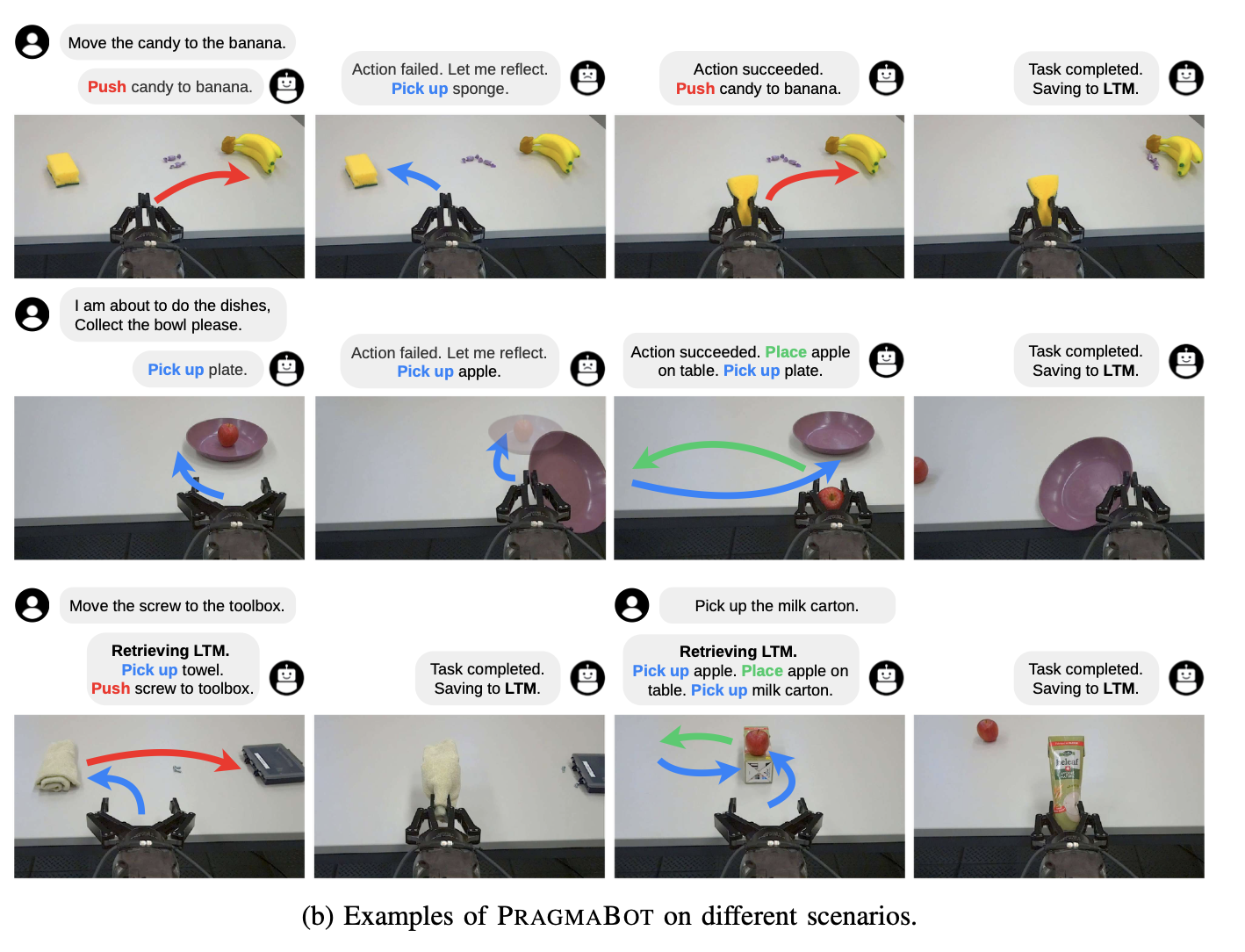

[PragmaBot, 2025]는 에이전틱 루프의 가장 완성된 형태를 보여줍니다. Verbal Reinforcement Learning 패러다임으로, LLM 에이전트가 파라미터 업데이트 없이 자기 반성과 few-shot 학습으로 경험에서 배웁니다.

VLM을 로봇의 "뇌"와 "눈"으로 활용하여 세 가지 역할을 수행합니다: (i) 행동 계획, (ii) 행동 성공 검증, (iii) 경험 요약. Short-term Memory(STM)는 실행된 행동과 피드백 신호를 추적하고, Long-term Memory(LTM)는 과거 성공 경험에서 배운 교훈을 저장합니다. RAG로 유사 작업 시 LTM에서 관련 지식을 검색하여 계획에 활용합니다.

결과는 인상적이었습니다:

| 조건 | 성공률 |

|---|---|

| Baseline (STM 없음) | 35% |

| STM 기반 자기 반성 | 84% (2.4배) |

| LTM + RAG (새 작업) | 80% (단일 시행) |

| Naive prompting | 22% |

STM만으로 35% → 84%, LTM+RAG로 새 작업에서 22% → 80%의 향상은, 에이전틱 루프의 각 구성요소(반성, 기억, 검색)가 각각 유의미한 기여를 함을 보여줍니다. 특히 Emergent intelligent object interactions — 예상하지 못한 창의적 물체 사용 행동 — 의 출현은 에이전틱 루프의 잠재력을 시사합니다.

8.6 에이전틱 루프의 진화 단계

네 논문을 관통하는 에이전틱 루프의 진화를 정리하면:

| 단계 | 시기 | 대표 | 루프 구조 |

|---|---|---|---|

| 개루프 | 2022 | SayCan, CaP | Plan → Execute (피드백 없음) |

| 반성 | 2023 | REFLECT | Plan → Execute → Reflect |

| 기억 | 2024 | KARMA, BUMBLE | Plan → Execute → Reflect → Remember → Plan |

| 완전 폐루프 | 2025 | PragmaBot | Plan → Execute → Reflect → Remember → Learn → Plan |

각 단계는 정확히 하나의 핵심 구성요소를 추가하며, PragmaBot에서 "경험으로부터 학습"이라는 최종 요소가 추가되어 완전한 폐루프가 형성됩니다.

8.7 Agentic Coding과의 대비: 루프 속도와 비용

에이전틱 루프의 구조는 동일하지만, 물리 세계의 비결정성·비가역성·비용이 각 단계의 난이도를 근본적으로 다르게 만듭니다.

| 루프 단계 | Agentic Coding | Agentic Robotics |

|---|---|---|

| 관찰 | 파일 읽기 (ms, 완전) | 카메라·센서 (노이즈, 부분) |

| 계획 | 코드 생성 (초) | 행동 시퀀스 생성 (초) |

| 실행 | 코드 실행 (ms, 결정론적) | 물리 행동 (분, 확률적) |

| 검증 | 테스트 (ms) | 관찰/시뮬레이션 (분) |

| 반성 | 에러 분석 (스택 트레이스) | 실패 분석 (다중 감각) |

| 기억 | 컨텍스트/파일 (즉시) | STM/LTM/씬 그래프 |

| 되돌리기 | git revert | 불가능 |

| 시행착오 비용 | ~무료 | 높음 |

PragmaBot의 35%→84% 향상은 에이전틱 루프의 보편적 효과를 보여줍니다. 그러나 BUMBLE의 47.1% 성공률은 물리 세계의 추가적 난점을 드러냅니다. 이 격차가 줄어들 수 있을까?

핵심은 루프 속도입니다. Agentic Coding의 루프는 수초입니다. PragmaBot의 루프는 수분~수십분입니다. 각 반복에서 배울 수 있는 양은 유사하지만, 단위 시간당 반복 횟수의 차이가 최종 성능의 차이를 결정합니다. 시뮬레이션 환경에서의 가속(→ Chapter 9)이 이 격차를 줄이는 핵심 전략입니다.

8.8 미해결 문제와 전망

첫째, Safety와 Autonomy의 균형입니다. AutoRT의 Robot Constitution은 규칙 기반 안전의 시작이지만, 규칙으로 열거할 수 없는 long-tail 위험이 문제입니다. 계층적 안전 아키텍처 — 하드웨어 수준의 반사적 안전(즉시 차단)과 소프트웨어 수준의 추론적 안전(LLM 기반 판단) — 가 필요합니다.

둘째, Long-horizon 누적 에러입니다. 각 단계 95% 성공률이라도 20단계 작업의 전체 성공률은 36%에 불과합니다. BUMBLE의 47.1%는 이 누적 효과를 반영합니다. 코드의 단위 테스트처럼 작업 중간 검증 포인트(checkpoint)를 설계하고, 적응적 재계획 빈도를 동적으로 결정하는 것이 해결 방향입니다.

셋째, 실시간 세계 모델입니다. 현재 VLA는 반응적(reactive)입니다 — 현재 관측에서 즉시 행동합니다. "이 물체를 이렇게 잡으면 어떻게 될까?"를 실시간으로 예측하는 내부 세계 모델이 아직 없습니다. GR00T N1의 dual-system이 이 방향의 시작이지만, 물리 예측의 정확도와 속도 모두 부족합니다.

에이전틱 루프가 물리 세계에서 완전히 작동하려면, 이 세 문제가 동시에 해결되어야 합니다. 각각은 독립적 연구 주제이지만, 통합 시스템에서의 상호작용이 최종 성능을 결정합니다.

참고문헌

- Liu, Z. et al., "REFLECT: Summarizing Robot Experiences for Failure Explanation and Correction," arXiv:2306.15724, 2023. scholar

- Brohan, A. et al., "AutoRT: Embodied Foundation Models for Large Scale Orchestration of Robotic Agents," arXiv:2401.12963, 2024. scholar

- Shah, M. et al., "BUMBLE: Unifying Reasoning and Acting with Vision-Language Models for Building-wide Mobile Manipulation," arXiv:2410.06237, 2024. scholar

- PragmaBot, "A Pragmatist Robot: Learning to Plan Tasks by Experiencing the Real World," arXiv:2507.16713, 2025. scholar

- Wang, Z. et al., "KARMA: Augmenting Embodied AI Agents with Long-and-short Term Memory Systems," arXiv:2409.14908, 2024. scholar

- NVIDIA, "GR00T N1: An Open Foundation Model for Generalist Humanoid Robots," arXiv:2503.14734, 2025. scholar

- Ahn, M. et al., "Do As I Can, Not As I Say: Grounding Language in Robotic Affordances," arXiv:2204.01691, 2022. scholar