Chapter 4: Vision-Language-Action 모델의 부상

요약

Agentic Robotics의 관점에서 VLA 모델은 단순한 "end-to-end 대안"이 아닙니다. Code as Policy가 pick(cup)이라는 고수준 명령을 생성할 때, 실제로 로봇 팔을 움직이는 저수준 모션은 누가 실행하는가? VLA는 바로 이 skill executor 역할 — 에이전틱 시스템의 코드가 호출하는 저수준 모션 프리미티브 — 로 자리매김하고 있습니다. 이 챕터에서는 VLA의 등장과 진화를 추적하되, Agentic Robotics 프레임워크에서 VLA가 차지하는 위치를 중심으로 분석합니다.

4.1 도입: 코드가 저수준 API를 필요로 할 때

Chapter 2-3에서 다룬 LLM Planner와 Code as Policy는 공통된 가정을 가집니다: 실행 가능한 저수준 스킬이 이미 존재한다는 것입니다. SayCan은 551개의 사전 정의된 스킬에서 선택하고, CaP는 robot.pick(), robot.place() 같은 API를 호출합니다. 그러나 이 API 뒤에서 실제 모터를 움직이는 정책은 별도로 필요합니다.

이것은 Agentic Coding에서 LLM이 requests.get(url)을 호출할 때 HTTP 라이브러리가 실제 네트워크 통신을 처리하는 것과 같습니다. 차이점은 네트워크 라이브러리는 결정론적이지만, 로봇의 저수준 모션은 확률적이고 환경에 의존한다는 것입니다. VLA는 이 "저수준 실행 레이어"를 범용화하려는 시도입니다.

한편, 모듈화된 파이프라인의 구조적 한계도 VLA를 촉발했습니다. LLM이 계획을 세우고, 별도의 perception 모듈이 환경을 인식하며, 또 다른 모듈이 저수준 제어를 담당할 때, 각 모듈 경계에서 정보 손실이 발생합니다. "하나의 모델이 모든 것을 처리하면 어떨까?" — 이 질문에서 VLA 패러다임이 탄생했습니다.

4.2 PaLM-E: 거대 멀티모달 모델의 가능성

[Driess et al., 2023]의 PaLM-E는 562B 파라미터의 embodied multimodal language model입니다. PaLM 540B 위에 이미지, 로봇 상태, 텍스트를 멀티모달 토큰으로 통합하여 입력합니다.

PaLM-E의 핵심 발견은 positive transfer입니다. 다양한 도메인(인터넷 이미지, 로봇 데이터)을 공동 학습하면 각 도메인의 성능이 향상됩니다. 스케일이 커질수록 언어 능력을 유지하면서 embodied 능력이 향상되었습니다. OK-VQA에서 state-of-the-art를 달성하는 동시에 로봇 조작 계획도 수행했습니다.

그러나 PaLM-E는 VLA가 아닌 "embodied LM"이었습니다. 행동을 직접 출력하지 않고 텍스트 형식의 계획을 생성했습니다. 562B라는 크기는 실시간 로봇 제어에 비현실적이었습니다. PaLM-E의 진정한 기여는 "웹 지식이 로봇 능력으로 전이될 수 있다"는 원리의 입증이었으며, 이것이 RT-2의 직접적 토대가 되었습니다.

4.3 RT-2: VLA 패러다임의 확립

[Brohan et al., 2023]의 RT-2는 VLA라는 용어를 사실상 확립한 논문입니다. 핵심 아이디어는 단순하면서도 강력합니다: VLM의 출력 토큰 공간에 로봇 행동을 포함시키는 것입니다.

RT-2는 PaLI-X(55B) 또는 PaLM-E(12B)를 로봇 궤적 데이터와 인터넷 VL 데이터로 공동 파인튜닝합니다. 로봇 행동은 텍스트 토큰으로 인코딩됩니다 — 예를 들어 "1 128 91 241 5 101 127"이 엔드 이펙터의 위치와 그리퍼 상태를 나타냅니다. 자연어 응답과 로봇 행동이 동일한 토큰 공간에서 학습됩니다.

6,000회의 평가 시행에서 RT-2의 가장 인상적인 결과는 emergent capabilities였습니다:

- Novel Object Generalization: 학습 데이터에 없는 물체에 대한 일반화

- Semantic Reasoning: "즉흥 망치로 쓸 수 있는 물체를 집어" → 돌을 선택

- Chain-of-Thought: "피곤한 사람에게 적합한 음료 선택" 같은 다단계 추론

웹에서 학습한 시각-언어 지식이 로봇 제어로 직접 전이된다는 근본적 증거였습니다. 학습 데이터에 없는 명령도 해석 가능했습니다.

RT-2의 한계는 세 가지였습니다. 55B 모델 크기로 인한 실시간 제어 지연, 단순 이산화(binning) 방식의 action tokenization으로 인한 고주파/정밀 조작 한계, 그리고 Google 로봇 데이터셋에 한정된 데이터 다양성입니다. 이 세 한계가 각각 후속 연구의 방향을 결정했습니다.

4.4 오픈소스 VLA 생태계의 폭발

2024년, VLA는 민주화되었습니다. 이 전환은 Agentic Coding에서 GPT-4(비공개) → Llama(오픈소스)로의 전환과 정확히 대응됩니다.

Open X-Embodiment: 데이터 허브의 구축

[Open X-Embodiment Collaboration, 2023]은 21개 기관, 150명 이상의 연구자가 참여하여 22개 로봇 실체, 527개 스킬, 100만 이상의 궤적을 포함하는 역대 최대 크로스-embodiment 데이터셋을 공개했습니다. RT-1-X(35M)와 RT-2-X(55B)가 이 데이터로 학습되었고, positive transfer — 다른 로봇의 데이터가 각 로봇의 성능을 향상시킨다는 것 — 이 대규모로 실증되었습니다.

Octo: 오픈소스 기준점

[Ghosh et al., 2024]의 Octo는 Open X-Embodiment의 80만 궤적으로 학습한 오픈소스 generalist policy입니다. Transformer 기반 diffusion policy 아키텍처에 readout token과 action chunking을 결합하여, 언어 명령 또는 목표 이미지로 지시 가능한 유연한 시스템을 구축했습니다. 9개 로봇 플랫폼에서 out-of-the-box로 작동하며, 파인튜닝 후 WidowX에서 55% 성공률을 달성했습니다.

OpenVLA: 7B의 돌파

[Kim et al., 2024]의 OpenVLA는 이 분야의 전환점입니다. Llama 2(7B) + DINOv2 + SigLIP을 결합한 7B VLA로, 97만 실제 로봇 데모로 학습되었습니다. RT-2-X(55B) 대비 +16.5% 성공률을 달성하면서 파라미터는 1/8입니다. LoRA 파인튜닝을 지원하여 소비자 GPU에서도 적응 가능하고, MIT 라이선스로 공개되어 커뮤니티 채택이 확산되었습니다.

OpenVLA는 "오픈소스 VLA가 비공개 대형 모델을 능가할 수 있다"는 증거를 제시했습니다. 이는 LLM 분야에서 Llama가 보여준 것과 동일한 패턴입니다.

TinyVLA: 극한의 경량화

[TinyVLA, 2024]는 1B 미만의 소형 VLM에 diffusion head를 결합하여 OpenVLA 대비 +25.7% 성공률을 달성했습니다. MetaWorld 50개 작업에서 Diffusion Policy 대비 +21.5%를 보이며, 언어, 객체, 위치, 외관, 배경, 환경 등 다양한 일반화 차원에서 강건함을 입증했습니다.

4.5 Action 표현의 혁명: Flow Matching과 FAST

RT-2의 action tokenization — 연속적 행동을 이산 토큰 bin으로 단순화 — 은 학습은 효율적이지만 정밀도에 한계가 있었습니다. 이를 극복하는 두 방향이 등장했습니다.

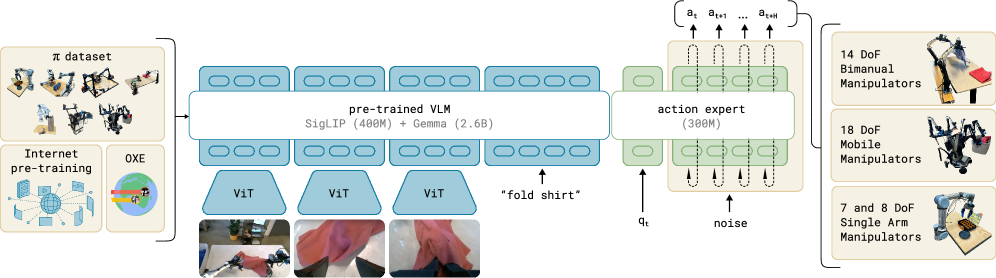

pi0: Flow Matching VLA

[Black et al., 2024]의 pi0는 Physical Intelligence가 개발한 flow matching 기반 VLA입니다.

pi0의 가장 인상적인 성과는 정교한 dexterous manipulation입니다. 셔츠 접기, 테이블 정리, 식료품 포장, 토스터에서 토스트 꺼내기 같은 다단계 작업에서 OpenVLA와 Octo를 일관적으로 상회했습니다. 세탁물 작업에서는 건조기에서 꺼내기 → 바구니에 넣기 → 접기 테이블로 이동 → 각 의류 접기의 연쇄를 수행했습니다.

pi0.5: Open-World로의 확장

[Physical Intelligence, 2025]의 pi0.5는 pi0을 open-world로 확장했습니다. 학습 데이터에 없는 완전히 새로운 집에서 주방/침실 청소 같은 long-horizon 작업을 수행하는 최초의 end-to-end 학습 기반 로봇 시스템입니다. Heterogeneous co-training(다양한 로봇 데이터, 고수준 의미 예측, 웹 데이터, 객체 감지)과 subtask prediction(고수준 서브태스크 예측 + 저수준 행동 생성)을 결합했습니다.

FAST: Action Tokenization의 혁신

[FAST, 2025]는 DCT(이산 코사인 변환) 기반 action tokenization으로 RT-2의 단순 binning을 대체합니다. 고주파 정밀 제어가 가능해지며, pi0과 결합 시 10,000시간 로봇 데이터 스케일의 학습이 가능하고, diffusion VLA에 필적하면서 학습 시간을 최대 5배 단축합니다. FAST+는 100만 실제 로봇 궤적으로 학습한 범용 action tokenizer입니다.

4.6 GR00T N1: Dual-System VLA

[NVIDIA, 2025]의 GR00T N1은 VLA의 진화 방향을 보여주는 중요한 이정표입니다. Dual-System Architecture를 명시적으로 구현합니다:

- System 2 (VLM): 환경을 해석하고 언어 지시를 이해하는 느린 추론

- System 1 (Diffusion Transformer): 실시간 모터 행동을 생성하는 빠른 행동

두 모듈은 end-to-end로 공동 학습됩니다. 실제 로봇 궤적 + 인간 비디오 + 합성 데이터를 혼합하여 학습하며, Fourier GR-1 humanoid에서 양손 조작 작업을 성공적으로 수행했습니다. GR00T-N1-2B는 모델 체크포인트, 학습 데이터, 벤치마크를 모두 공개하여 오픈소스 생태계에 기여했습니다.

GR00T N1의 Dual-System은 이 챕터에서 다룬 모든 VLA의 스케일 vs 속도 트레이드오프에 대한 구조적 해답입니다. 고수준 추론(느리지만 강력한)과 저수준 제어(빠르지만 반응적인)를 분리함으로써, 562B PaLM-E의 추론 능력과 50Hz 실시간 제어를 동시에 추구합니다 (→ Chapter 5에서 계층적 접근 상세 분석).

4.7 VLA 설계의 5대 선택지

2024-2025년의 VLA 연구를 관통하는 다섯 가지 핵심 설계 축이 있습니다:

| 설계 축 | 선택지 | 대표 모델 |

|---|---|---|

| Action 표현 | Discrete token / Flow matching / Diffusion | RT-2 / pi0 / Octo |

| 모델 크기 | 55B / 7B / <1B | RT-2-X / OpenVLA / TinyVLA |

| 사전학습 데이터 | 웹+로봇 / 로봇만 / 시뮬레이션 | RT-2 / Octo / GR00T N1 |

| 아키텍처 | Monolithic / Hierarchical / Dual-system | RT-2 / HAMSTER / GR00T N1 |

| 오픈소스 | 비공개 / 공개 | RT-2, pi0 / OpenVLA, Octo, GR00T N1 |

"What Matters in Building VLA Models" [2024]은 8개 VLM backbone, 4개 policy 아키텍처, 600개 이상의 실험으로 체계적 분석을 수행하여, 연속 행동 공간 + policy-head 구조가 가장 효과적이며, cross-embodiment 데이터는 파인튜닝/사후학습에서 더 효과적임을 발견했습니다.

4.8 Agentic Coding과의 대비: VLA는 Agentic Framework의 어디에 위치하는가

이 장의 핵심 질문은 "VLA가 모듈형 시스템을 대체하는가?"가 아닙니다. "Agentic Robotics에서 VLA는 어떤 역할을 하는가?"입니다.

세미나에서 제시된 구분이 명확합니다: Large Model(VLA)은 빠르지만 실패하고, System-Level Orchestration은 느리지만 강건합니다. VLA 단독으로는 long-horizon 작업에서 누적 오류가 급증하지만(BUMBLE 47.1%), 에이전틱 오케스트레이션과 결합하면 각 서브태스크를 안정적으로 실행할 수 있습니다. GR00T N1의 Dual-System은 이 결합의 구조적 해답입니다 — System 2(VLM)가 계획하고, System 1(VLA)이 실행합니다.

Agentic Coding과의 비대칭도 이 맥락에서 이해됩니다. Agentic Coding에서 LLM은 코드를 생성하고, Python 런타임이 실행합니다. 중간 표현(코드)이 해석 가능합니다. Agentic Robotics에서 오케스트레이터(LLM/VLM)가 계획을 세우고, VLA가 실행합니다. 그러나 VLA의 중간 표현은 불투명한 신경망 활성화입니다. Code as Policy(→ Chapter 3)가 이 간극을 줄이려는 시도이며, CaP-X가 보여준 것처럼 에이전틱 스캐폴딩(test-time computation)이 이 불투명성을 보완할 수 있습니다.

이 차이가 왜 근본적인지를 세 가지로 설명할 수 있습니다.

첫째, 디버깅의 난이도입니다. 코드 에이전트가 잘못된 출력을 내면, 생성된 코드를 읽고 어디서 논리가 틀렸는지 파악할 수 있습니다. VLA가 잘못된 행동을 출력하면, 내부 표현을 해석하는 것이 현재 기술로는 거의 불가능합니다.

둘째, 일반화의 기반입니다. RT-2가 웹 지식을 로봇 행동으로 전이하는 것은, LLM이 코드 학습 데이터의 지식을 새로운 프로그래밍 문제에 전이하는 것과 유사합니다. 그러나 코드는 자연어와 같은 토큰 공간에 자연스럽게 있지만, 로봇 행동은 인위적인 action tokenization이 필요합니다. FAST가 이 토큰화를 혁신한 것은 이 비대칭을 줄이려는 시도입니다.

셋째, 데이터의 비대칭입니다. LLM 학습에는 인터넷의 수조 토큰이 사용됩니다. VLA 학습에는 가장 큰 데이터셋인 Open X-Embodiment조차 100만 궤적에 불과합니다. DROID [Khazatsky et al., 2024]가 13개 기관, 564개 장면에서 76,000 궤적을 수집한 것이 최대 규모의 in-the-wild 데이터입니다. 이 데이터 격차가 VLA의 일반화 한계를 결정하며, pi0.5의 heterogeneous co-training은 이 격차를 다양한 소스로 보완하려는 전략입니다.

4.9 미해결 문제와 전망

VLA 패러다임이 직면한 다섯 가지 근본적 한계가 있습니다.

Action Tokenization vs Continuous: 이산 토큰은 학습 효율적이지만 정밀도 한계가 있고, 연속 행동은 정밀하지만 학습이 어렵습니다. FAST의 DCT 기반 접근이 절충안을 제시했지만, 최적의 action 표현은 아직 열린 문제입니다.

Scale vs Speed: 큰 모델은 일반화가 우수하지만 실시간 제어가 불가합니다. GR00T N1의 Dual-System과 TinyVLA의 경량화가 양 방향에서 접근하고 있으나, 둘의 최적 결합점은 미정립입니다 (→ Chapter 5).

데이터 병목: 실제 로봇 데이터 수집 비용이 극도로 높습니다. 시뮬레이션, 인간 비디오, 합성 데이터의 활용이 확대되고 있지만, 진정한 contact-rich manipulation 데이터는 여전히 희소합니다.

Open-world 일반화: pi0.5가 최초로 시도했지만, "open-world"의 범위는 아직 주거 환경에 한정됩니다. 공장, 농장, 병원 같은 다양한 환경으로의 확장이 필요합니다.

Safety: VLA가 직접 행동을 출력하므로, 위험한 행동을 사전에 차단하는 메커니즘이 필요합니다. AutoRT [Brohan et al., 2024]의 Robot Constitution이 시작이지만, VLA 내부에 safety constraint를 내재화하는 연구는 아직 초기 단계입니다 (→ Chapter 8).

Hybrid의 미래: 궁극적 방향은 VLA 단독도, 순수 모듈형도 아닌 하이브리드입니다. 고전적 TAMP + VLM 추론의 결합(진행 상태에 따라 VLM이 개입하는 프레임 레벨 트리거), 그리고 System-Level Orchestration의 지식을 VLA로 증류(distillation)하여 속도와 강건성을 동시에 달성하는 접근이 유망합니다. 이 방향은 Agentic Coding에서 LLM이 코드를 생성하되, 타입 체커와 린터가 실시간으로 교정하는 것과 유사합니다 — 빠른 생성(VLA)과 엄격한 검증(TAMP/orchestration)의 결합입니다.

참고문헌

- Driess, D. et al., "PaLM-E: An Embodied Multimodal Language Model," arXiv:2303.03378, 2023. scholar

- Brohan, A. et al., "RT-2: Vision-Language-Action Models Transfer Web Knowledge to Robotic Control," arXiv:2307.15818, 2023. scholar

- Open X-Embodiment Collaboration, "Open X-Embodiment: Robotic Learning Datasets and RT-X Models," arXiv:2310.08864, 2023. scholar

- Ghosh, D. et al., "Octo: An Open-Source Generalist Robot Policy," arXiv:2405.12213, 2024. scholar

- Kim, M. J. et al., "OpenVLA: An Open-Source Vision-Language-Action Model," arXiv:2406.09246, 2024. scholar

- Black, K. et al., "π0: A Vision-Language-Action Flow Model for General Robot Control," arXiv:2410.24164, 2024. scholar

- Physical Intelligence, "π0.5: A Vision-Language-Action Model with Open-World Generalization," arXiv:2504.16054, 2025. scholar

- NVIDIA, "GR00T N1: An Open Foundation Model for Generalist Humanoid Robots," arXiv:2503.14734, 2025. scholar

- FAST, "Efficient Action Tokenization for Vision-Language-Action Models," arXiv:2501.09747, 2025. scholar

- TinyVLA, "TinyVLA: Towards Fast and Data-Efficient Vision-Language-Action Models," arXiv:2409.12514, 2024. scholar

- Chi, C. et al., "Diffusion Policy: Visuomotor Policy Learning via Action Diffusion," arXiv:2303.04137, 2023. scholar

- Khazatsky, A. et al., "DROID: A Large-Scale In-The-Wild Robot Manipulation Dataset," arXiv:2403.12945, 2024. scholar

- Brohan, A. et al., "AutoRT: Embodied Foundation Models for Large Scale Orchestration of Robotic Agents," arXiv:2401.12963, 2024. scholar

- "What Matters in Building Vision-Language-Action Models," arXiv:2412.14058, 2024. scholar